Zu viel KI Forschung wird als Spektakel praesentiert. Neue Benchmarks erscheinen, neue Modellnamen trendieren, und jede Woche legt ein neues Diagramm nahe, dass Faehigkeit allein schon Strategie sei. Ich halte das für die falsche Sicht. Serioese KI Forschung ist wertvoll, weil sie Unsicherheit bei einem schwierigen Problem reduziert. Wenn sie keine Produktentscheidung, keine Systementscheidung und keine wissenschaftliche Hypothese schaerft, ist sie vielleicht interessant, aber noch nicht operativ bedeutsam.

In der Praxis sind die nuetzlichsten Forschungsteams nicht die lautesten. Es sind die Teams, die Methode schuetzen. Sie schreiben die Frage praezise auf, definieren wie eine bessere Antwort aussehen wuerde, bauen eine Evaluation bevor sie über Architektur streiten und dokumentieren, wo das Modell scheitert. Genau diese Disziplin verwandelt Exploration in dauerhaften Vorteil.

Beginnen Sie mit einer engen Frage, nicht mit einem modischen Modell

Ein serioeses Forschungsvorhaben beginnt meist mit einer engen Frage, die ein Team ehrlich testen kann: können wir die Retrieval Qualitaet auf diesem Korpus verbessern, Halluzination in diesem Workflow senken, eine Fehlerklasse vor dem Release erkennen oder die Latenz verkleinern ohne Genauigkeit zu verlieren. Enge Fragen wirken bescheiden, aber sie schaffen Hebelwirkung, weil sie sagen, welche Evidenz wirklich zaehlt.

Evaluation kommt vor Architektur Verehrung

Ich vertraue keinen Forschungsprogrammen, die eine Architektur wählen bevor sie Erfolg definieren. Evaluation ist das Betriebssystem guter KI Forschung. Wenn man Datensatz, Aufgabenrahmen, negative Faelle, menschliche Review Methode und akzeptable Verhaltensschwelle nicht erklären kann, wird der Rest des Stacks zur Erzaehlung. Ein Modell kann in einer Demo beeindrucken und im einzigen wichtigen Kontext trotzdem versagen.

- Definieren Sie Fehlermuster bevor Sie Fortschritt behaupten.

- Messen Sie Qualitaet mit operatorrelevanten Beispielen.

- Dokumentieren Sie, was sich wirklich geaendert hat.

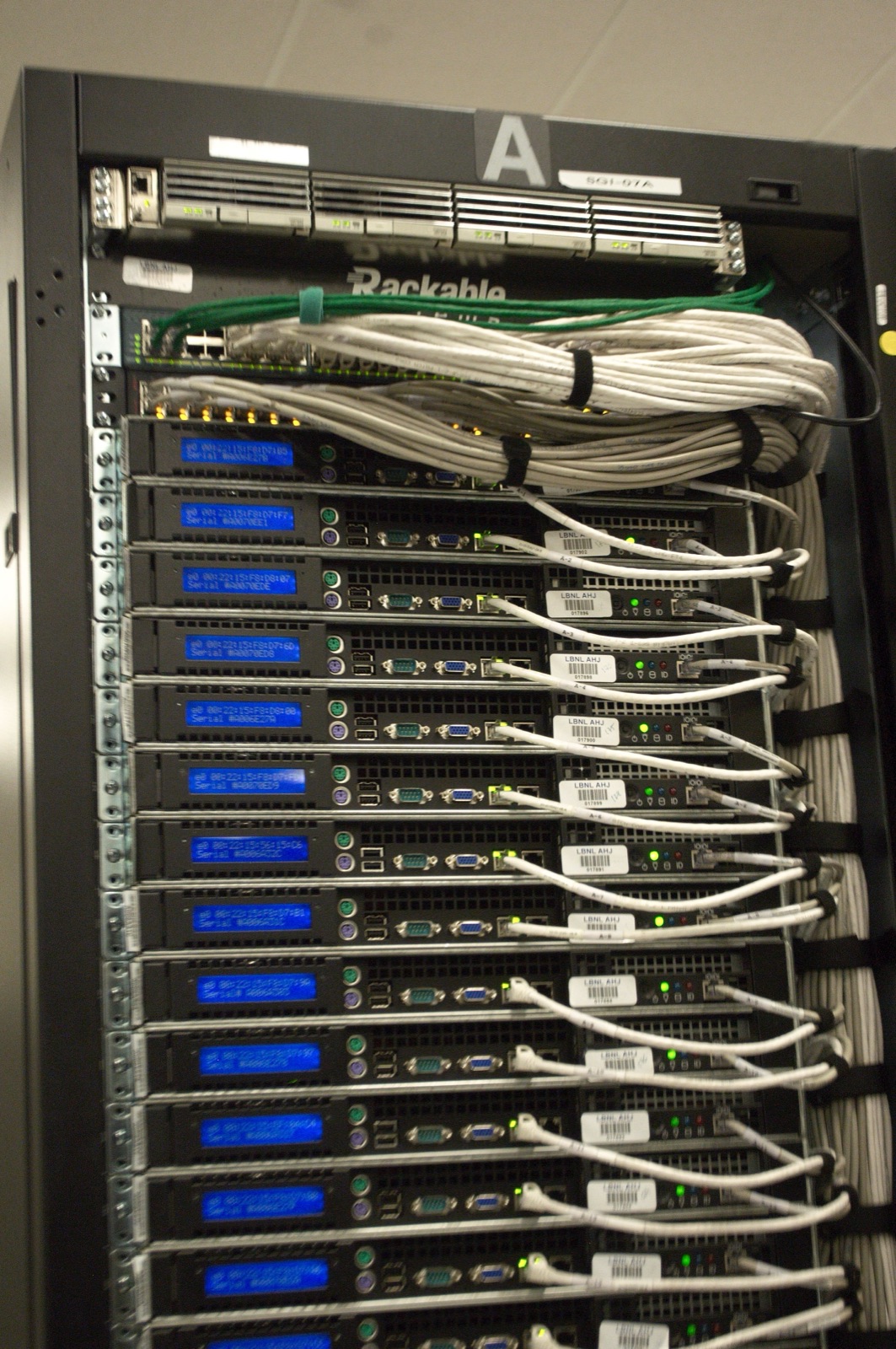

Forschung, Produkt und Daten muessen in einer Schleife leben

Die staerksten Applied AI Teams trennen Forschung nicht von Produktion. Forschende muessen den Workflow verstehen, Produktverantwortliche die Evaluationslogik und Datenarbeit muss nah an beiden liegen. Wenn diese Funktionen auseinanderdriften, wird Forschung elegant aber unbrauchbar, Produkt ungeduldig und Datenqualitaet erodiert still. Eine gemeinsame Schleife haelt das gesamte System ehrlich.

Negative Ergebnisse gehoeren zum Vermoegen

Ein Zeichen schwacher Forschungskultur ist, dass nur Erfolgsgeschichten aufbewahrt werden. In gesunden Teams gelten negative Befunde ebenfalls als Vermoegen. Fehlgeschlagene Prompt Strukturen, schwache Retrieval Einstellungen, falsche Annahmen und teure Sackgassen sollten dokumentiert werden. Diese Gewohnheit verhindert Wiederholung, spart Budget und schafft eine Kultur, die auf Wahrheit statt internes Theater optimiert.

Irgendwann weiss serioese Forschung auch, wann sie aufhoeren muss. Das Ziel ist nicht endlose Exploration. Das Ziel ist bessere Entscheidung auf Basis besserer Evidenz. Wenn die Unsicherheit klein genug geworden ist, sollte das Team liefern, beobachten und aus echter Nutzung lernen. Forschung ohne Wirklichkeitskontakt wird langsam selbstbezogen.

Mein Test ist einfach: Kann das Team Frage, Evaluation, negative Faelle, Zielkonflikte und Shipping Entscheidung in klarer Sprache erklären? Wenn ja, ist die Forschung wahrscheinlich serioes. Wenn die Erklaerung in Markennamen und Benchmark Screenshots zerfaellt, fuehrt das Team noch Intelligenz auf, statt sie zu bauen.