Trop de recherche IA est presentee comme un spectacle. De nouveaux benchmarks apparaissent, de nouveaux noms de modeles circulent, et chaque semaine un nouveau schema laisse entendre que la capacite seule est une stratégie. Je ne partage pas cette lecture. Une recherche IA serieuse a de la valeur parce qu elle reduit l incertitude autour d un probleme difficile. Si elle ne clarifie pas une decision produit, une decision systeme ou une hypothese scientifique, elle peut être interessante sans être encore utile dans l operationnel.

Dans la pratique, les équipes de recherche les plus utiles ne sont pas celles qui produisent les annonces les plus bruyantes. Ce sont celles qui protegent la méthode. Elles ecrivent la question avec précision, definissent ce qu une meilleure réponse devrait être, construisent une evaluation avant de debattre de l architecture et documentent ou le modele echoue. Cette discipline transforme l exploration en avantage durable.

Commencez par une question etroite, pas par un modele a la mode

Un effort de recherche serieux commence souvent par une question etroite qu une équipe peut tester honnetement: peut on ameliorer la qualite du retrieval sur ce corpus, reduire l hallucination dans ce workflow, detecter une classe d erreur avant la mise en production, raccourcir la latence sans detruire la précision. Les questions etroites paraissent modestes, mais elles creent l effet de levier parce qu elles disent quelle preuve compte vraiment.

L evaluation vient avant le culte de l architecture

Je ne fais pas confiance aux programmes de recherche qui choisissent une architecture avant de definir le succès. L evaluation est le systeme d exploitation d une bonne recherche IA. Si vous ne pouvez pas expliquer le jeu de donnees, le cadrage de la tache, les cas negatifs, la méthode de revue humaine et le seuil de comportement acceptable, le reste de la pile devient un recit. Un modele peut impressionner en demo et echouer dans le seul contexte qui compte.

- Definir les cas d echec avant de revendiquer un progres.

- Mesurer la qualite avec des exemples utiles aux operateurs.

- Documenter ce qui a reellement change quand la performance bouge.

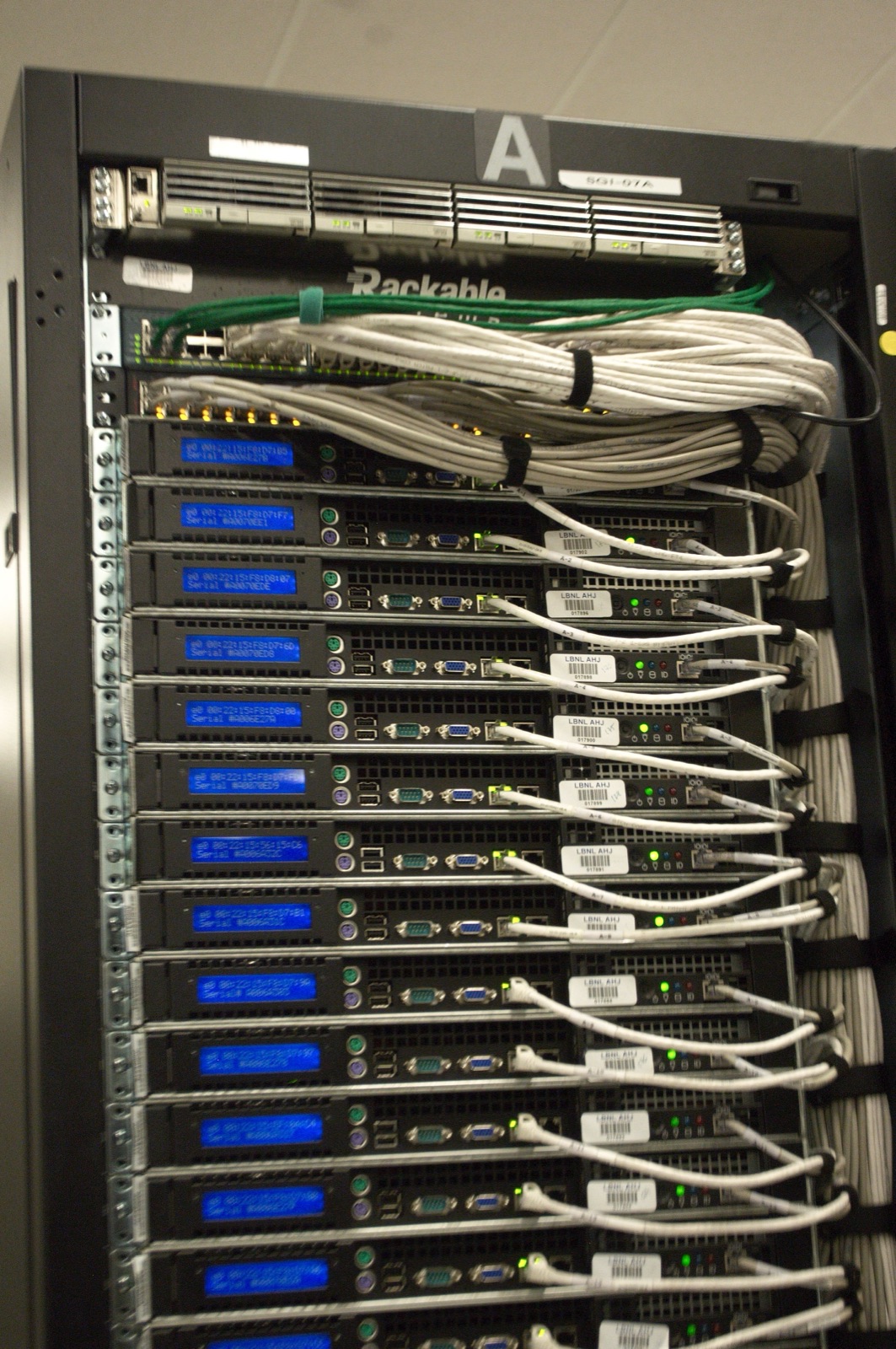

Recherche, produit et donnees doivent vivre dans une seule boucle

Les meilleures équipes d IA appliquee n isolent pas la recherche de la production. Les chercheurs doivent comprendre le workflow, les responsables produit doivent comprendre la logique d evaluation et le travail sur les donnees doit rester proche des deux. Quand ces fonctions derivent, la recherche devient elegante mais inutilisable, le produit devient impatient et la qualite des donnees se degrade en silence. Une boucle partagee garde l ensemble honnete.

Les résultats negatifs font partie de l actif

Un signe de culture faible est la conservation exclusive des histoires gagnantes. Dans les équipes saines, les constats negatifs sont traites comme des actifs. Les structures de prompt inefficaces, les mauvais parametres de retrieval, les hypotheses cassees et les impasses couteuses doivent tous être notes. Cette habitude evite la repetition, protege le budget et construit une culture qui optimise pour la verite plutot que pour le theatre interne.

A un moment, une recherche serieuse sait aussi s arrêter. Le but n est pas d explorer sans fin. Le but est de decider avec de meilleures preuves. Quand la marge d incertitude devient assez faible, l équipe doit livrer, monitorer et apprendre du vrai usage. Une recherche qui ne rencontre jamais la realite finit par parler surtout d elle meme.

Mon test est simple: l équipe peut elle expliquer la question, l evaluation, les cas negatifs, les compromis et la decision de livraison dans un langage normal? Si oui, la recherche est probablement serieuse. Si l explication s effondre dans les noms de marque et les captures de benchmark, l équipe joue encore l intelligence au lieu de la construire.